�l���r�g��2015-06-09 �l���ߣ� �c����

�����҂���Ҫ֪��robots�ļ��r��ʲô�ģ���ŵ�λ�������

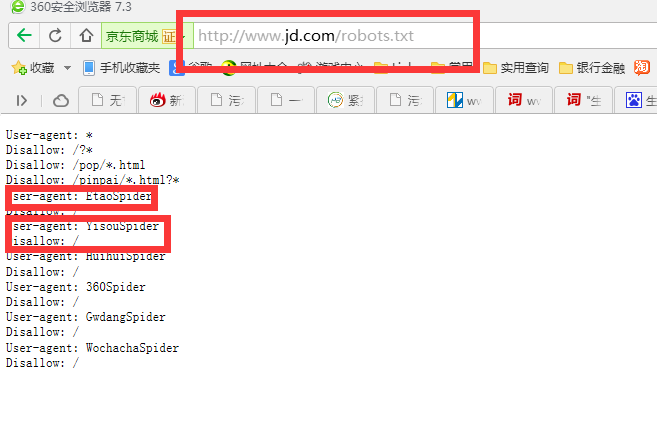

robots�ļ���Ҫ�Ǹ��V�������棬�Wվ��Щ������ץȡ����Щ���ܽ^ץȡ�������҂����ׂ��؈D��

���|ţB�ɣ��ܽ^��360��һ�ԾW��

disallow����Ҫ�����Ǿܽ^ijЩָ������������ץȡ�҂���������Ҋ����棬������Iվ���҂��϶���ϣ�����������ץȡ�҂���ô�@��disallow������ʲô���w�����أ��䌍�҂�������disallow�ܽ^404�e�`�ĵ�ַ�������؏͵���棡

User-agent: * ������ֹ���е���������ץȡ�����ݣ�

Disallow��/blog/����ֹ�Wվblog��Ŀ�����е���档�����f��/blog/123.html��

Disallow��/api�������f��/apifsdfds/123.htmlҲ�������Ρ���

Disallow��*?*��ֻҪ���·�����控�І�̖��·������ô�@�l·�����������Ρ������f��http://xxxxx/?expert/default.html���������Ρ���

Disallow��/*.php$����˼����.php�Yβ��·��ȫ�����ε�����

Sitemap:http://xxx.com/sitemap.html �Wվ�؈D ���V���x�@������ǾWվ�؈D

User-agent: * ���S�L������

Disallow: / �ܽ^����

Allow: /tmp �@�ﶨ�x�����S����tmp������Ŀ�

Allow: .htm$ �H���S�L����".htm"���Y��URL��

Allow: .gif$ ���Sץȡ�W퓺�gif��ʽ�DƬ

�������������w�Ո�c��